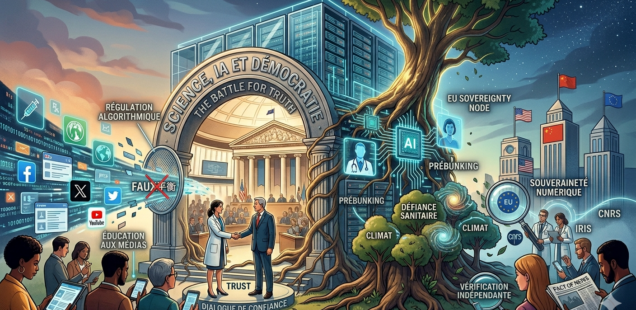

SCIENCE, IA ET DEMOCRATIE

Et si la crise de la parole scientifique que nous avons vécue ces dernières années n’était que l’arbre qui cache la forêt ? Derrière la défiance envers les vaccins, les débats climatiques et les controverses sanitaires, se joue un bouleversement bien plus vaste. Nous avons basculé dans une ère où le vrai ne s’impose plus par la preuve, mais par sa capacité à générer des émotions.

A travers ces vidéos, nous analysons comment la science a été malmenée, transformant le doute scientifique – pourtant moteur de la recherche – en un signe d’incompétence aux yeux du public. Nous verrons également comment les plateformes numériques et leurs algorithmes, loin d’être neutres, tirent profit de cette polarisation. Mais pour comprendre cette transformation, il faut aller plus loin : l’intelligence artificielle est devenue le nouveau nerf de la guerre géopolitique entre les puissances mondiales.

Parole scientifique et restauration de la confiance

La crise du Covid-19 n’a pas seulement été une urgence sanitaire ; elle a agi comme un révélateur brutal de la fragilité de la parole scientifique dans l’espace public. Entre désinformation et perte de repères, l’entretien entre le journaliste Patrick Cohen et le Président du Comité consultatif national d’éthique Jean-François Delfraissy lors de l’émission de la Grande Matinale de France Inter nous alerte : lorsque la science est malmenée, c’est la démocratie elle-même qui vacille.

Dans son dernier ouvrage, Les Mystificateurs, Patrick Cohen dresse un constat cinglant : des personnalités, bénéficiant parfois d’une aura scientifique réelle ou usurpée, ont délibérément diffusé des contre-vérités. Ce phénomène transforme des opinions marginales en « vérités alternatives ». En s’appuyant sur leur notoriété, ces figures parviennent à séduire une audience massive, faisant primer l’émotion et la conviction personnelle sur la rigueur de la preuve. L’un des points les plus critiques de l’analyse concerne la dérive des plateaux de télévision. Pour garantir une apparence d’impartialité, les médias tombent souvent dans le piège du faux équilibre : d’un côté, un consensus scientifique solide (porté par des institutions comme le GIEC et de l’autre, une voix dissidente, souvent spectaculaire et provocatrice. En mettant ces deux paroles sur un pied d’égalité, le média transforme un fait établi en un simple débat d’opinion. Le spectacle l’emporte alors sur la rigueur, et le public finit par croire que « personne n’est d’accord ».

Jean-François Delfraissy souligne, quant à lui, une mutation profonde de notre rapport à l’autorité. La science n’est plus vue comme une quête de savoir, mais comme une institution dont il faut se méfier par principe. Dans ce contexte, le complotisme devient une arme de résistance perçue pour ceux qui se sentent délaissés par les élites, transformant chaque fait scientifique en un sujet de discorde idéologique.

Pourquoi les véritables experts peinent-ils à se faire entendre ? L’entretien pointe un paradoxe fondamental. La science avance par le doute. Un chercheur honnête admettra toujours une part d’incertitude. Mais le public attend des certitudes. Dans l’arène médiatique, ce doute est trop souvent interprété comme de l’incompétence ou de l’hésitation. Cette difficulté de communication laisse le champ libre aux parleurs les plus affirmés, qui séduisent par des réponses simples (mais fausses) à des problèmes complexes.

Si le constat de la fracture entre science et société est posé, comment passer de la méfiance à l’adhésion ? Lors d’une table ronde au salon MedInTechs, des experts de tous horizons — de l’AP-HP à Publicis Santé, en passant par Pfizer et Terra Nova — ont esquissé les contours d’une nouvelle stratégie pour contrer l’ « infodémie ».

Pour Nicolas Castoldi (AP-HP), la réponse ne peut plus être uniquement institutionnelle. Face à une remise en question globale de l’autorité, la science doit « entrer dans l’arène ». Un constat est dressé : Un logo d’hôpital ou d’institution ne suffit plus à valider une information. La solution réside dans l’incarnation. Les chercheurs, les médecins et les soignants doivent, en effet, prendre la parole en leur nom propre. En racontant leur réalité de terrain, ils redonnent un visage humain et authentique à la rigueur scientifique. Mathias Moreau (Publicis Santé) souligne, quant à lui, un paradoxe structurel : une fake news est conçue pour être virale car elle mobilise l’émotion pure et le storytelling simplifié. À l’inverse, la science demande du temps, de la nuance et accepte l’incertitude.

Le défi est de réhabiliter le doute scientifique. Loin d’être un signe de faiblesse ou d’incompétence, le doute doit être réexpliqué au public comme le moteur même de la découverte. L’enjeu est de rendre la complexité aussi captivante que le sensationnalisme.

Acteur souvent décrié, l’industrie doit aussi faire sa mue communicationnelle. Luca Mollo (Pfizer France) rappelle une réalité économique et réglementaire souvent méconnue. Les bénéfices financiers ne sont pas une fin en soi mais le moteur de l’innovation future. En outre, l’industrie pharmaceutique est l’un des secteurs les plus contrôlés au monde, où chaque donnée publiée subit des processus de validation drastiques. La transparence totale sur ces processus est le seul remède contre les fantasmes de manipulation.

Par ailleurs, Mélanie Heard (Terra Nova) propose un changement de paradigme fascinant : et si la désinformation n’était pas une contagion passive, mais une volonté des citoyens de participer à la création de sens ? Plutôt que de simplement « expliquer des trucs compliqués » de manière descendante, les scientifiques doivent accepter le cadre des réseaux sociaux, qu’elle compare à un théâtre d’improvisation géant. L’objectif est d’intégrer le citoyen dans la réflexion plutôt que de le traiter en simple récepteur d’informations.

Pour conclure ce débat essentiel, les intervenants ont proposé une feuille de route concrète pour restaurer la crédibilité scientifique. L’éducation aux médias figure parmi les solutions : comprendre le business model des réseaux sociaux et le fonctionnement des algorithmes pour ne plus être l’esclave des flux d’informations. Autre alternative : le « Prébunking ». Au lieu de courir après les rumeurs (le debunking), il s’agit d’immuniser l’esprit critique en amont en expliquant les mécanismes de la manipulation avant qu’elle ne survienne. Une autre option peut être choisie en valorisant les professionnels de santé de proximité (pharmaciens, médecins de famille) comme les relais ultimes de l’information vérifiée. Enfin, la stratégie d’ouverturepeut être adoptée en ouvrantles portes des laboratoires et des institutions pour désamorcer les théories du complot par la preuve visuelle et l’accessibilité.

Des infox à la géopolitique de l’IA

Si la communication des experts doit évoluer, elle fait face à un adversaire de taille : la structure même des réseaux sociaux. Une étude récente de l’ONG Science Feedback (relayée par la journaliste Mylène Girardeau pour TV5MONDE) vient confirmer une réalité mathématique implacable : sur Internet, la désinformation ne se contente pas de circuler, elle est littéralement « primée ».

L’étude prouve que, pour un même nombre d’abonnés, un compte diffusant des contenus trompeurs génère un engagement (likes, partages, commentaires) massivement supérieur à celui d’une source fiable. L’écart est abyssal selon les plateformes. Les chiffres révèlent un système où la rigueur scientifique est un handicap de visibilité face au sensationnalisme.

Ce phénomène n’est pas un accident technique, mais un choix structurel. Les « Facebook Files » l’ont démontré : les algorithmes de recommandation valorisent prioritairement les réactions suscitant de la colère ou de l’indignation, car ce sont elles qui retiennent l’utilisateur le plus longtemps sur l’écran.

Malgré les rapports d’ONG et les alertes répétées, la volonté de changement des géants du numérique reste quasi inexistante, le profit publicitaire étant intrinsèquement lié au temps d’attention, peu importe la qualité de l’information consommée.

Toutes les plateformes ne sont pas égales face au risque d’infox. Le taux de pénétration de la désinformation varie considérablement. TikTok est le plus exposé : une vidéo sur quatre (25 %) y serait biaisée. LinkedIn apparaît, quant à lui, comme le dernier refuge de la crédibilité avec seulement 1 % de contenus trompeurs, grâce à un cadre professionnel plus régulé. Sans surprise, les thèmes de prédilection des « marchands de doute » sont ceux qui touchent à nos peurs ou à nos valeurs : la santé en tête, suivie du climat, de la politique et de l’immigration.

L’arrivée massive de l’Intelligence Artificielle générative aggrave la situation. Désormais, une vidéo sur quatre sur TikTok et une sur cinq sur YouTube intègre de l’IA, souvent sans aucune mention.

On voit ainsi apparaître des avatars de médecins, créés de toutes pièces par des algorithmes, qui vantent des remèdes miracles pour des pathologies complexes. Cette « science de synthèse » brouille définitivement la frontière entre expertise réelle et manipulation technologique.

Face à ce constat, le fact-checking interne des plateformes semble n’être qu’un remède « cosmétique ». Pour les experts de Science Feedback et de TV5MONDE, la solution doit être radicale : modifier la source même du trafic. L’idée serait d’intégrer des signaux de crédibilité fournis par des experts indépendants directement dans les algorithmes de recommandation. Au lieu de favoriser ce qui fait réagir, le système devrait prioriser ce qui est vérifié. En résumé : faire en sorte que la « bonne monnaie » informationnelle finisse enfin par chasser la mauvaise.

Pour clore cette réflexion sur la vérité et l’information, il est essentiel de lever les yeux vers les infrastructures qui soutiennent ces technologies. Lors d’une table ronde organisée par l’IRIS et NEOMA Business School, des experts ont été formels : l’IA n’est plus une affaire de lignes de code. C’est un levier de puissance qui redéfinit la souveraineté des nations et les rapports de force entre les États-Unis, la Chine et l’Europe.

L’un des points les plus troublants abordés par Marie Garin (CNRS) est l’infiltration de la recherche par les géants du numérique (Google, Meta, Microsoft). À l’instar de l’industrie du tabac autrefois, les Big Tech financent massivement des études pour détourner l’attention des problèmes de vie privée ou de biais algorithmiques. De plus, 97 % des chercheurs en éthique de l’IA auraient des liens financiers avec ces entreprises. Ce cadrage du débat permet d’orienter les régulations avant même qu’elles ne soient écrites.

En outre, Philippe Barbet (Université Sorbonne Paris Nord) souligne que la domination actuelle repose sur une chaîne de valeur extrêmement fragile. Nvidia contrôle 95 % du marché des composants en silicium nécessaires à l’IA. Paradoxalement, la toute-puissance américaine dépend de Taïwan (TSMC) pour la fabrication et des Pays-Bas (ASML) pour les machines de gravure. Enfin, pour contourner les embargos, Pékin investit massivement dans les terres rares et développe des modèles comme DeepSeek, prouvant que la course à l’armement numérique ne fait que commencer.

L’IA s’incarne dans des Data Centers colossaux, véritables usines du XXIe siècle. Charles Thibout (Sciences Po Strasbourg) et les intervenants alertent sur l’impact physique de ces infrastructures : un seul centre dédié à l’IA consomme autant d’énergie que 300 centres de données classiques. Cette boulimie électrique et hydraulique (pour le refroidissement) pose un dilemme majeur : peut-on concilier transition écologique et course effrénée à l’intelligence artificielle ?

Face aux projets pharaoniques comme Stargate aux États-Unis (500 milliards d’euros), l’Europe semble cantonnée à un rôle de régulateur. Si elle est l’« arbitre » qui siffle les fautes, elle manque encore de joueurs capables de rivaliser sur le terrain de la puissance brute. La question de la souveraineté numérique européenne reste entière.

Enfin, derrière la magie des algorithmes, se cache le « travail du clic ». Des milliers de travailleurs, notamment au Kenya ou à Madagascar, sont payés quelques centimes pour annoter des données ou modérer des contenus traumatisants. Cette main-d’œuvre invisible, indispensable au fonctionnement de l’IA occidentale, dessine les contours d’une nouvelle exploitation mondiale.

L’information est devenue une infrastructure de pouvoir. Protéger la démocratie implique non seulement de réinvestir la parole scientifique, mais aussi de réguler les algorithmes et de bâtir une véritable souveraineté technologique.